¿Es el crecimiento económico finito? El pesimismo entrópico de Georgescu-Roegen

Artículo publicado originalmente en la Revista Ágora Perene

La teoría del decrecimiento, defendida por los partidarios del ecologismo radical de la Deep Ecology, presenta una crítica contundente a las tesis de la economía tradicional de crecimiento económico ilimitado y lineal, una crítica que resuena en la sociedad en general. ¿Tienen razón sobre la naturaleza finita del crecimiento? ¿Nos dirigiremos, en el futuro, a un agotamiento catastrófico de las capacidades productivas? La ley físico-termodinámica de la entropía, con su paradigma de declive energético gradual de la naturaleza, constituye un serio desafío al optimismo económico liberal y a su ideal de prosperidad material humana. Esta idea sería incorporada por primera vez a la ciencia económica en la década de 1970, con el advenimiento de la bioeconomía del economista rumano Nicholas Georgescu-Roegen, el principal inspirador del movimiento del decrecimiento.

Introducción

El filósofo alemán Friedrich Nietzsche describió al hombre con la imagen metafórica de un ser creador y destructor, semejante a una llama:

“¡Sí! Sé de dónde vengo,

Nunca saciado, como un fuego, resplandeciente, yo mismo consumo.

Todo lo que agarro y toco hace luz,

Todo lo que dejo atrás son cenizas,

Ciertamente, llama es lo que soy.”

Esta imagen del hombre como productor de luz y muerte por el toque refleja claramente la idea prometeica de un ser explorador y dominador de la naturaleza. En contraposición a esta imagen prometeica, un filósofo alemán posterior, Martin Heidegger, instó al hombre a ser el “pastor de la tierra”, a aceptar su humilde papel como parte del mundo, evitando la tecnología, la dominación y el papel de explorador (Bramwell, 1989).

La metáfora del Hombre Prometeico y del Hombre Pastor, presentes en Nietzsche y Heidegger, respectivamente, refleja dos concepciones antagónicas del hombre y su relación con el mundo, con importantes manifestaciones en el pensamiento humano, literario y científico, a lo largo de la historia.

El hombre pastor

La idea del Hombre Pastor comparte muchas similitudes con el ideal estético y ético de la vida tradicional defendida por muchos poetas y escritores ligados a un romanticismo nostálgico, aristocrático y conservador. Esta visión, a diferencia de lo que se afirma con frecuencia en el sentido común, de ninguna manera contradice el liberalismo económico, siendo fácilmente aceptada por economistas de línea ordoliberal, como el alemán Wilhelm Röpke.

Esta visión orgánica de la economía, que une las necesidades del hombre y de la naturaleza, pone de relieve un tema importante que no debe ser condenado ni negado per se, bajo el riesgo de incurrir en una epistemología autista y alienante de la realidad.

Sin embargo, debe notarse que esta visión bucólica y nostálgica del Hombre Pastor, de base cultural, se convertiría en blanco de fuertes manipulaciones y apropiaciones políticas en las últimas décadas por ciertos grupos con ideologías marcadas por el extremo zelotismo ambiental y sectario.

Ecologismo profundo

Un ejemplo claro de este tipo de ideología es la tesis del decrecimiento económico, que ha ido ganando terreno entre los partidarios del ecologismo radical en las últimas décadas, sobre todo en la corriente conocida como Deep Ecology, especialmente en los países desarrollados. Esta tesis aboga por el decrecimiento y políticas activas de desindustrialización, desinversiones y reducción drástica del consumo. Argumenta basándose en la finitud de los recursos energéticos y pone en cuestión importantes avances de la civilización proporcionados por la Revolución Industrial, así como las mejoras en el estándar de vida material de las masas en los últimos siglos.

La teoría del decrecimiento presenta una crítica contundente a las tesis de la economía tradicional de crecimiento económico ilimitado y lineal, una crítica que no se limita a su círculo inmediato de defensores, sino que resuena en la sociedad en general, haciéndose muy presente en los discursos de importantes liderazgos ambientalistas globales, como Greta Thunberg.

Toda ideología, por más caricaturesca que sea al representar la realidad, necesita estar anclada, aunque sea parcialmente, en alguna verdad para existir socialmente. Detrás de la tesis del decrecimiento, hay una verdad profundamente incómoda, cuya negación por parte de los críticos puede llevar a la apología de un extremo opuesto igualmente distorsionado y parcial.

Esta verdad tiene que ver con la creencia en el crecimiento infinito y en la disponibilidad ilimitada de recursos para sustentar el proceso económico. Surge entonces una reflexión inevitable: ¿la producción humana tendrá realmente un límite? ¿Nos dirigiremos, en el futuro, a un agotamiento catastrófico de las capacidades productivas? ¿O la tecnología será capaz de superar la escasez de recursos energéticos y físicos?

Las limitaciones epistemológicas de la economía neoclásica

Es precisamente aquí donde se encuentra la mayor debilidad argumentativa de los críticos a la tesis del decrecimiento. Hay que reconocer que la economía mainstream, con todo su aparato positivista y jerga técnica especializada, aún no ha logrado presentar una respuesta teórica satisfactoria al problema de la finitud de los recursos. Desde 1870, con el surgimiento de la ciencia económica neoclásica, los economistas (con algunas excepciones notables) parecían creer que el crecimiento económico era sostenible indefinidamente y que los recursos naturales eran inagotables, sustentados por una epistemología newtoniana y mecanicista de la realidad natural, que no concuerda con los avances teóricos posteriores de la física.

En este sentido, la mayor limitación de la ciencia económica neoclásica fue su incapacidad para conciliar su optimismo con los nuevos descubrimientos ocurridos en el campo de las ciencias biológicas y físicas en el siglo XIX, como la ley de la entropía de la termodinámica, cada vez más pesimistas respecto a la posibilidad de generación infinita de energía y la continuidad de la vida natural en el futuro.

Este desajuste entre el optimismo económico y el pesimismo de las ciencias biofísicas se manifestaría de manera más clara a lo largo del siglo XX. Desde la década de 1970, y con el objetivo de llenar este vacío, comenzaría a establecerse una serie de nuevos paradigmas vinculados al medio ambiente en la economía mainstream, cuestionando la idea de crecimiento indefinido y lineal y utilizando el aparato teórico de las ciencias naturales.

Bioeconomía

Estos nuevos paradigmas, impulsados por el avance de las ideas ecologistas entre las décadas de 1960 y 1970, variaban desde posiciones moderadas a favor de la conservación y el crecimiento gestionado de los recursos —como los defensores de la tesis del “desarrollo sostenible”— hasta posiciones radicales de la Deep Ecology, que rechazan explícitamente el crecimiento económico y se muestran contrarias a la posibilidad de cualquier sistema económico autosostenible (Pearce y Turner, 1989).

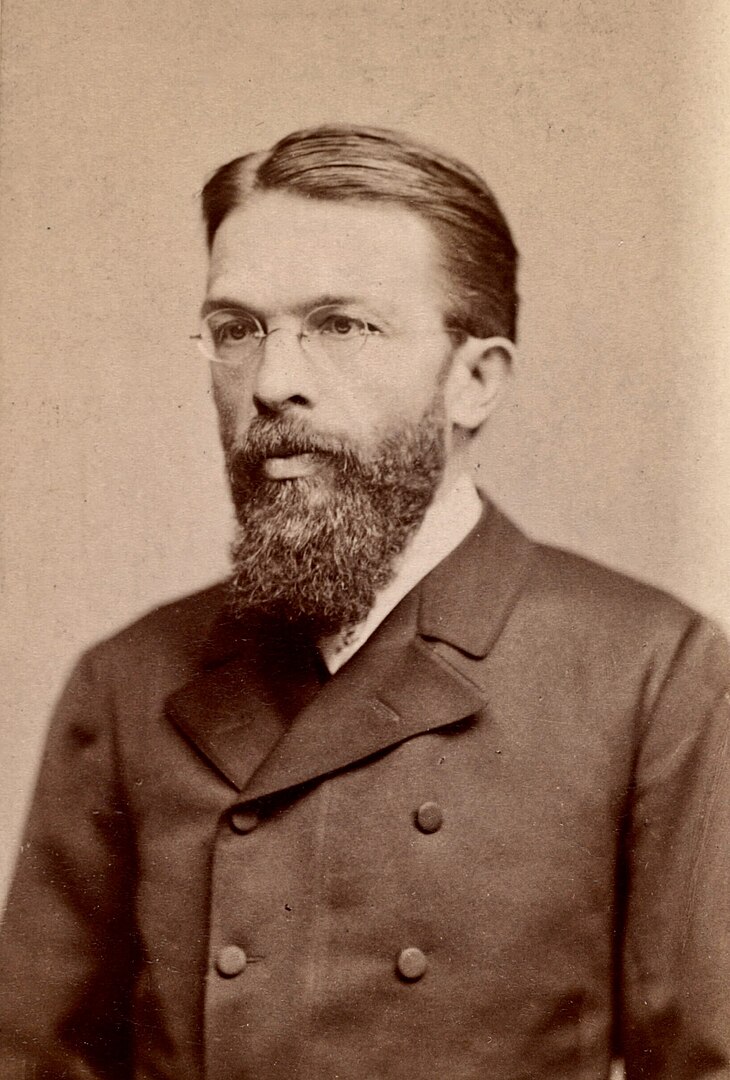

La teoría de la bioeconomía, formulada por el economista rumano Nicholas Georgescu-Roegen, fue claramente una fuente de inspiración para la mayoría de los partidarios del decrecimiento, aunque el autor no fue, él mismo, un defensor directo del movimiento (Missemer, 2017). Su principal obra, expuesta en The Entropy Law and the Economic Process (1971), presenta la economía como un subsistema integrado a un sistema bioeconómico global.

Esto lleva a la idea de que la economía está regida por un proceso dinámico de producción, circulación y distribución de bienes y residuos, semejante al existente en el subsistema biológico evolutivo —un sistema limitado en términos energéticos y materiales y en continuo decaimiento a largo plazo, regido por la Ley de la Entropía.

La bioeconomía entrópica de Nicholas Georgescu-Roegen

El modelo entrópico del economista rumano Georgescu-Roegen fue profundamente influenciado por las teorías alemanas de la energética social del siglo XIX, que integrarían la biofísica en la explicación de los procesos económicos de producción, trabajo y consumo. También fue fuertemente influenciado por el institucionalismo y la economía evolutiva del austriaco Schumpeter, a través de la visión de cambios dinámicos cualitativos en los métodos de producción económica. Sus ideas de una economía evolutiva, sin equilibrio estático y antimecanicista, encuentran paralelismos con la concepción dinámica del proceso económico de la Escuela Austriaca de Economía de Carl Menger, Bohm-Bawerk y Ludwig von Mises.

Las ideas fundamentales de su teoría fueron presentadas entre las décadas de 1930 y 1940, a partir de sus trabajos en la economía agraria y en la crítica a la teoría del consumidor y a la función de producción neoclásica (Heinzel, 2013). Georgescu, durante los años 1930, tuvo contacto con economistas de Harvard, donde se convirtió en discípulo de Schumpeter, y desarrolló estudios sobre la temática de la economía neoclásica. Su teoría de la bioeconomía tuvo sus primeras ideas formuladas en ese período, influenciada por sus experiencias con la vida económica campesina al regresar a Rumanía, en los años 1940 (Goudy y Mesner, 1998).

The entropy law and the economic process

En The Entropy Law and the Economic Process (1971), Georgescu-Roegen contribuyó con la incorporación del modelo teórico de la termodinámica física en el análisis económico, siendo más conocido por el uso de la Ley de la Entropía, la Segunda Ley de la Termodinámica. Esta ley es descrita por Georgescu como “la más económica de todas las leyes naturales” y “la raíz principal de la escasez económica”.

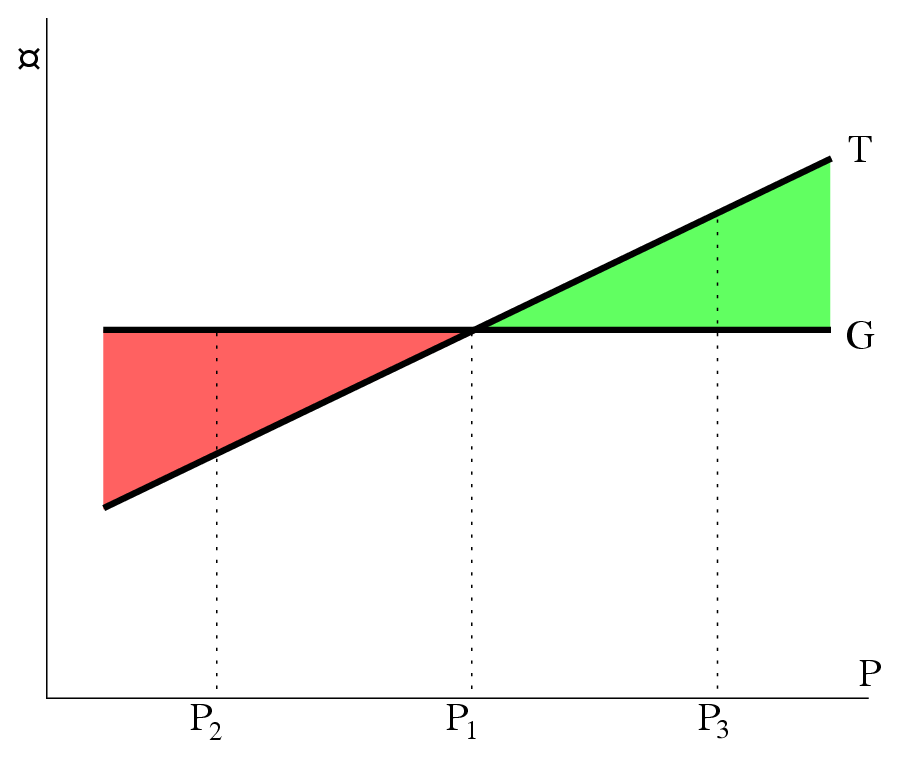

Georgescu, basándose en la ley termodinámica de la entropía y crítico del modelo económico neoclásico heredado del mecanicismo de la física clásica, estableció el modelo de la bioeconomía. Este modelo consiste en un marco teórico dinámico para la economía, que propone que la energía física contiene un stock natural finito, lo que impone restricciones al crecimiento económico.

La bioeconomía de Georgescu-Roegen, al enfatizar la finitud física no solo de la materia, sino también de la energía, marca una ruptura categórica con el modelo estándar y mecánico de la economía de autorreproducción (Miernyk, 1990). El modelo tradicional de flujo circular, promovido desde el siglo XVIII por los fisiócratas franceses y en los siglos XIX y XX por los modelos teóricos neoclásicos de Leon Walras y Gustav Cassel, se caracteriza por un movimiento perpetuo, en el que el consumo va en una dirección y la producción en otra, alcanzando un punto de equilibrio.

El aumento de la entropía

Según la teoría bioeconómica, las actividades económicas degradan acumulativamente el medio ambiente con el tiempo (aumentando la entropía, de acuerdo con las leyes de la termodinámica) y los cambios ambientales alteran, a su vez, el proceso económico. La economía de la biosfera es un sistema cerrado en el cual la entropía aumenta continuamente (e irrevocablemente) hasta un máximo: la energía disponible se transforma continuamente en energía no disponible, hasta que desaparezca por completo.

El proceso económico es la producción de entropía y se opone al movimiento perpetuo de la teoría estándar. La materia está sujeta a la misma degradación que la energía, a través de un fenómeno acumulativo. La conclusión ineludible de estos postulados es que el sistema económico global tiene un ciclo de vida similar al de un organismo vivo (Bobulescu, 2012).

Cuerpos endosomáticos vs exosomáticos

La bioeconomía también establece que el sistema económico está regido por una dinámica evolutiva similar a la existente en el sistema biológico. Georgescu-Roegen postuló que el proceso económico es una extensión de la evolución biológica, al distinguir entre cuerpos endosomáticos y exosomáticos. El cuerpo somático de todo ser biológico está dotado de órganos endosomáticos naturales. La especie humana agrega y complementa los cuerpos endosomáticos de la biología al crear herramientas, máquinas e instrumentos externos, que se convierten en órganos exosomáticos.

Los cambios evolutivos, incluidos los exosomáticos, son de naturaleza cualitativa, y todas las entidades afectadas por un cambio cualitativo son necesariamente dialécticas.

Conceptos aritmórficos vs dialécticos

Georgescu distinguió entre conceptos matemáticos (aritmórficos) y lingüísticos (dialécticos), lo que le permitió abordar importantes construcciones teóricas. Los conceptos aritmórficos se definen por su distinción discreta entre números individuales en un continuo aritmético, que, por lo tanto, nunca se sobreponen. En contraste, en los conceptos dialécticos no hay separación discreta entre ellos. Están separados de sus opuestos por una “penumbra dialéctica”. Por ejemplo, viejo y joven son conceptos dialécticos. Un niño será un anciano cuando tenga 90 años, pero nadie puede decir con certeza cuándo envejecerá (Bobulescu, 2012).

Al enfatizar la naturaleza dialéctica de los conceptos económicos, Georgescu consideró que el proceso económico está caracterizado por una discontinuidad lógica, por cambios y desequilibrios históricos que requieren un enfoque diferente al cálculo marginal cuantitativo neoclásico (Heinzel, 2013).

Crítica a la matematización de la economía

Las críticas de Georgescu al supuesto de integrabilidad matemática en la economía lo llevaron a establecer objeciones a la teoría de decisión racional microeconómica, señalando una limitación intrínseca de la teoría del consumidor (Zamagni, 1999). Demostró que las curvas integrales de la ecuación diferencial que representan la condición de equilibrio del consumidor no corresponden necesariamente al mapa de indiferencia del consumidor. Por lo tanto, la realidad observable de las elecciones y preferencias de los consumidores no sigue obligatoriamente los axiomas del comportamiento del consumidor, como la utilidad marginal decreciente.

A partir de sus experiencias con la economía agrícola en Rumanía, Georgescu concluyó que el modelo económico estándar, en el que el consumidor o productor funciona como en el equilibrio walrasiano, no puede coincidir con la economía agraria. La inercia social y el principio de subsistencia en las zonas rurales superpobladas se oponen al modelo hedonista de consumo en las ciudades. Las instituciones agrícolas no se ajustaban al principio cuantitativo de maximización de beneficios (Heinzel, 2013).

Su ataque contundente contra las funciones de producción neoclásicas (como la de Cobb-Douglas) afirma que estas funciones son construcciones matemáticas que contradicen las leyes físicas. Georgescu-Roegen se apartó radicalmente del análisis convencional y construyó un modelo de flujo de fondos del proceso de producción basado en los recursos naturales, en el cual la “producción” corresponde a un proceso de transformación. Los recursos (flujos) se transforman en productos y residuos. El trabajo y el capital son agentes de transformación (fondos) que permiten esta transformación. Durante este proceso de producción-transformación, la entropía aumenta (Georgescu-Roegen, 1971).

Continuidad con Schumpeter

En resumen, Georgescu-Roegen llenó importantes lagunas dejadas por la economía neoclásica al incorporar las ciencias biológicas en el análisis de la dinámica económica. Georgescu considera que la economía sigue un proceso evolutivo regido por las leyes de la termodinámica. Este proceso tiene una importante dimensión cualitativa, que no puede ser capturada por el instrumental económico tradicional, centrado en variaciones “marginales” numéricas.

Especialmente al demostrar la necesaria interrelación entre la actividad económica y el medio ambiente natural, Georgescu destacó la omnipresencia e inevitabilidad de los problemas y limitaciones ambientales asociados a cualquier actividad económica. En varios trabajos importantes, se percibe una continuidad con la teoría institucionalista y evolucionista de Schumpeter, siguiendo particularmente la preocupación central de su maestro con el tema de la evolución y con la metodología (Heinzel, 2013).

Aunque Georgescu-Roegen no lo defendió, la introducción de la ley de la entropía en el análisis económico influiría en el surgimiento del movimiento de decrecimiento económico a partir de los años 70. Este movimiento ecológico adoptaría una postura radical respecto al proceso productivo actual, yendo más allá de las tesis habituales de estacionariedad económica y limitación del consumo, al abogar por una política de continua desindustrialización, desinversiones y reducción del PIB, con el objetivo de retardar el proceso de decaimiento energético natural provocado por el crecimiento entrópico.

Un modelo dinámico y cualitativo frente al mecanicismo neoclásico

Algunos autores consideran que el propio movimiento de decrecimiento distorsionó la teoría bioeconómica de Georgescu, al asumir una epistemología que no la representa exactamente. Esto ocurre al defender una postura de reducción cuantitativa del nivel de actividad y de control “mecanicista” de la economía, una posición incompatible con el modelo dinámico evolucionista y cualitativo de la bioeconomía (Missemer, 2017). Más correcto sería hablar de una postura de “acrecimiento” de la bioeconomía que de un “decrecimiento” inducido por planes de control estatal sobre la actividad. Esta visión de acrecimiento sería más coherente con una teoría que guarda similitudes con la epistemología antimecanicista de la Escuela Austríaca de Economía, que influiría en Schumpeter y Georgescu.

Aún así, debe considerarse, por último, que la bioeconomía entrópica de Georgescu y su paradigma del declive energético gradual de la naturaleza constituyen un gran obstáculo para la teoría económica neoclásica convencional y su modelo estático mecanicista, además de exponer serios desafíos al optimismo económico liberal y su ideal de prosperidad material humana.

Bibliografía

Bobulescu, R. (2012). The making of a schumpeterian economist: Nicholas georgescu-roegen. The European Journal of the History of Economic Thought, 19(4), 625-651.

Bramwell, A. (1990). Ecology in the twentieth century: A history. Journal of the History of Biology, 23(3)

Georgescu-Roegen, N. (1971). The entropy law and the economic process Harvard university press.

Gowdy, J., & Mesner, S. (1998). The evolution of Georgescu-Roegen’s bioeconomics. Review of Social Economy, 56(2), 136-156.

Heinzel, C. (2013). Schumpeter and georgescu-roegen on the foundations of an evolutionary analysis. Cambridge Journal of Economics, 37(2), 251-271.

Miernyk, W.H. (1990). A mind ahead of its time. Libertas Mathematica, 10: 5–20. Reprinted in Georgescu-Roegen (1996: 183–93).

Missemer, A. (2017). Nicholas Georgescu-Roegen and degrowth. The European Journal of the History of Economic Thought, 24(3), 493-506.

Pearce, D. W., & Turner, R. K. (1989). Economics of natural resources and the environment Johns Hopkins University Press.

Zamagni, S. (1999). Georgescu-roegen on consumer theory: An assessment. Bioeconomics and Sustainability: Essays in Honor of Nicholas Georgescu-Roegen, 103-124.